En Bref

- Gemma 4 passe sous licence Apache 2.0, autorisant l’usage commercial, la modification et la redistribution sans restriction.

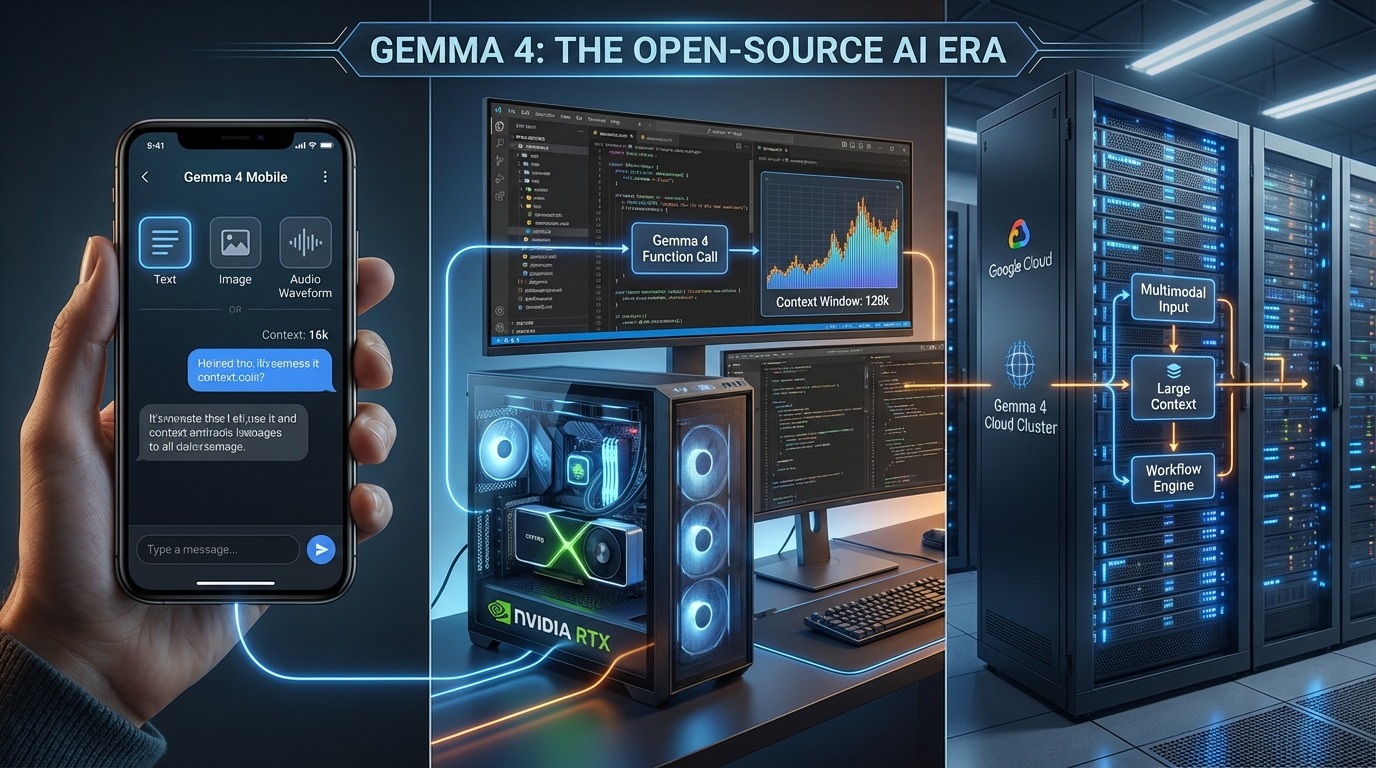

- Quatre modèles open source couvrent tous les besoins: E2B, E4B pour les mobiles et l’edge; 26B MoE pour les PC grand public; 31B Dense pour le cloud.

- Support natif de la vision, de l’audio, d’une fenêtre de contexte étendue (jusqu’à 256 000 tokens) et des workflows agentiques.

- Disponibilité sur Hugging Face, Kaggle, Ollama, ainsi que Google AI Studio et Google AI Edge Gallery; déploiement via Vertex AI, Cloud Run et GKE.

- Compatibilité immédiate avec Transformers, vLLM, llama.cpp, MLX, LM Studio, Unsloth et Keras.

Avec Gemma 4, Google étend le terrain de jeu de l’intelligence artificielle ouverte en alignant enfin sa politique de licence avec les standards de l’écosystème. Lancée le 2 avril 2026, cette famille de modèles open source couvre tout le spectre, du smartphone aux instances cloud les plus musclées. La nouveauté décisive tient dans l’adoption de la licence Apache 2.0, qui clarifie la réutilisation commerciale et l’intégration produit. Concrètement, les entreprises peuvent déployer, adapter et redistribuer sans friction juridique, ce qui abaisse drastiquement le coût d’exploration et de mise en production.

Derrière l’annonce, l’enjeu dépasse la simple course aux benchmarks. Car ces modèles misent sur une intelligence « par paramètre » optimisée, un socle machine learning pensé pour les mobiles, les PC et le cloud, ainsi qu’une capacité multimodale robuste (texte, image, vidéo, audio). Au passage, la prise en main s’avère directe pour les équipes: téléchargements sur Hugging Face, accélération via vLLM, déploiements gérés sur Vertex AI. Face à la pression concurrentielle et aux discussions sur la souveraineté numérique, l’initiative marque une innovation stratégique. Elle rebat les cartes de l’IA embarquée et des agents autonomes, avec un rapport performance/coût qui cible la production réelle plutôt que les démonstrations en laboratoire.

Gemma 4 et la licence Apache 2.0 : un tournant pour l’open source professionnel

Le passage à la licence Apache 2.0 constitue le pivot de la gamme Gemma 4. Avant ce changement, des conditions d’utilisation plus restrictives freinaient l’industrialisation et la redistribution. Désormais, l’usage commercial, la modification et la distribution sont explicitement permis. Cette clarté contractuelle accélère les cycles d’adoption, puisque les juristes et les DPO disposent d’un cadre éprouvé, largement compris dans l’industrie. En pratique, une startup peut intégrer un modèle pré-entraîné, opérer un fine-tuning spécifique, puis livrer un binaire interne ou packagé sans négociations additionnelles.

Ce tournant s’inscrit dans une bataille plus large. D’un côté, des modèles propriétaires demeurent très performants et intégrés à des suites cloud fermées. De l’autre, Google positionne Gemma 4 comme un socle ouvert, multimodal et optimisé pour l’edge. Ce choix répond à une attente forte des DSI: limiter la latence, réduire les coûts opérationnels, et garder un contrôle strict sur la donnée. Plusieurs acteurs comparent déjà cette stratégie aux annonces concurrentes et à la dynamique du marché, comme l’analyse abordée dans ce décryptage de la contre-attaque face à OpenAI. Les lignes bougent, et l’open source retrouve un rôle moteur dans l’IA appliquée.

Autre point à considérer: l’historique de la famille. La première itération date de 2024, puis Gemma 3 a été livrée en 2025. Selon Google, la somme des téléchargements dépasse 400 millions. Cette traction favorise l’écosystème de fine-tuning, d’évaluations et d’intégrations, puisque chaque nouvelle version s’appuie sur des outils, des guides et des retours d’expérience existants. En retour, les coûts d’onboarding chutent pour les équipes produit qui disposent déjà d’une chaîne MLOps prête.

Sur le terrain, la conformité s’améliore aussi. L’absence de clauses ambiguës lève de multiples points de friction avec les directions juridiques. Ensuite, la licence Apache 2.0 s’articule très bien avec les pratiques DevOps: images container, charts Helm et registres privés se mettent en place sans amender des conditions opaques. Au final, ce socle légal fluide libère l’expérimentation, puis l’industrialisation, avec une traçabilité claire du code et des poids de modèles.

Pour les organisations publiques, l’effet catalyseur est réel. Les services numériques d’État et les collectivités peuvent bâtir des briques modulaires, tout en gardant la donnée in-situ. Le contexte de modernisation des portails numériques trouve ici une base technique crédible, autant pour les assistants internes que pour les guichets citoyens. En somme, l’adoption d’Apache 2.0 change la donne: elle transforme une promesse en capacité opérationnelle concrète.

Quatre modèles Gemma 4 pour mobiles, PC et cloud : panorama technique et cas concrets

La famille Gemma 4 se décline en quatre variantes pour couvrir les mobiles, les PC et le cloud. Les modèles E2B et E4B ciblent l’embarqué, en partenariat avec Qualcomm et MediaTek. Ils fonctionnent totalement hors ligne sur smartphone, Raspberry Pi ou Nvidia Jetson Orin Nano. Ils disposent d’une entrée audio native et d’une fenêtre de contexte de 128 000 tokens, ce qui autorise des applications comme la prise de notes multimédia ou la transcription enrichie avec résumés localisés. Pour les développeurs Android, l’accès via AICore Developer Preview accélère l’intégration dans des applications existantes.

Le 26B MoE (Mixture-of-Experts) active seulement une partie des paramètres à l’inférence. Cette approche réduit la latence et la consommation VRAM, ce qui convient à des PC équipés de GPU grand public. Par exemple, un studio de design peut lancer des sessions multimodales sur une carte 12 Go, et tenir des itérations courtes sans cluster. À l’autre extrémité, le 31B Dense maximise la qualité et le potentiel de fine-tuning. Il étend la fenêtre de contexte jusqu’à 256 000 tokens, idéale pour des audits documentaires, des revues de code massives ou des assistants juridiques internes.

Les capacités clés s’alignent sur des usages avancés. On retrouve le raisonnement multi-étapes, les workflows agentiques avec appels de fonctions et sorties JSON structurées, la vision (OCR, graphiques, vidéos) et une génération de code hors ligne de haute qualité. Cette combinaison nourrit des assistants métiers fiables: agents support, copilotes data, automations RPA contrôlées. Une PME peut, par exemple, combiner E4B pour le pré-traitement image sur site et 31B Dense pour la consolidation analytique dans le cloud, tout en maîtrisant son budget.

- Mobiles et edge: E2B, E4B avec audio natif et 128k tokens.

- PC grand public: 26B MoE pour un bon ratio vitesse/VRAM.

- Cloud et fine-tuning: 31B Dense avec 256k tokens.

- Multimodal: texte, images, vidéo, OCR et compréhension de graphiques.

- Agents: appels de fonctions, sorties JSON, intégration outils/API.

Ces blocs techniques répondent à des besoins métiers clairs. Le retail peut automatiser la lecture des factures et des tickets avec OCR robuste. L’industrie peut doter ses techniciens d’un copilote offline, embarqué sur tablette durcie. Et la finance peut auditer des corpus volumineux avec une fenêtre étendue. Cette granularité d’options permet d’orchestrer le juste modèle au bon endroit, sans compromis inutile.

Ce panorama ouvre sur la question du déploiement. Quels chemins pratiques pour passer du prototype à la production, sur poste, en edge et dans le cloud géré? Les outils compatibles jouent ici un rôle décisif.

Déployer Gemma 4: outils, frameworks et pipelines MLOps prêts pour la production

Gemma 4 s’intègre dès le premier jour avec des briques populaires du machine learning. Les poids se téléchargent via Hugging Face, Kaggle et Ollama. Les modèles 31B Dense et 26B MoE sont accessibles dans Google AI Studio. Côté edge, Google AI Edge Gallery propose E2B et E4B. Pour les déploiements cloud, l’intégration se fait sur Vertex AI, Cloud Run et GKE. De plus, la compatibilité couvre Transformers, vLLM, llama.cpp, MLX, LM Studio, Unsloth et Keras. Ce spectre abaisse la barrière d’entrée pour les équipes.

On-device et Android: le raccourci AICore

Sur Android, l’aperçu développeur AICore facilite l’exécution locale des variantes edge. Ainsi, un éditeur d’applications peut greffer une transcription audio offline, puis un résumé en temps réel, sans serveur. En combinant E4B et un pipeline OCR, un lecteur de documents multilingue se met en place pour le terrain. La gestion fine du cache et des prompts courts maintient la latence à un niveau acceptable. Les données sensibles restent sur l’appareil, ce qui rassure les équipes légales.

Cloud-native: Vertex AI, Cloud Run et GKE

En cloud géré, Vertex AI offre le monitoring, l’autoscaling et la facturation consolidée. Cloud Run se révèle pertinent pour des microservices serveurless, tandis que GKE s’adresse aux environnements conteneurisés exigeants. Une feuille de route type suit quatre étapes claires: préparer les jeux de données, choisir le modèle (26B MoE pour la latence, 31B Dense pour la qualité), automatiser l’évaluation, puis industrialiser l’inférence avec de la journalisation et des garde-fous. Ce cadre se combine à la recherche d’autonomie technologique des organisations, car l’orchestration peut rester portable.

- Préparer un corpus propre et documenté (format, anonymisation, droits).

- Sélectionner la variante Gemma 4 selon la VRAM et la latence cible.

- Évaluer avec des jeux tenus à l’écart du training pour éviter la fuite.

- Déployer sur Vertex AI, Cloud Run ou GKE avec observabilité et tests A/B.

Au-delà, la chaîne outillée influe sur la qualité des livrables. Les frameworks tels que vLLM simplifient la montée en charge, tandis que llama.cpp facilite l’optimisation CPU et l’exécution locale. Pour les équipes Apple Silicon, MLX et LM Studio accélèrent l’itération. Enfin, des cas d’usage linguistiques gagnent en pertinence avec les efforts parallèles de Google en traduction, à l’image de TranslateGemma, utile pour bâtir des assistants multilingues robustes.

Ces filières de déploiement montrent un point clé: l’exécution locale, le PC et le cloud ne s’opposent pas. Ils se complètent. Les architectures hybrides maximisent la valeur en rapprochant l’IA du besoin réel et de la donnée utile.

Cas d’usage Gemma 4: agents autonomes, vision, audio et génération de code en contexte

Pour mesurer l’impact de Gemma 4, rien ne vaut des scénarios concrets. Imaginons Atlas Retail, une enseigne omnicanale. En boutique, une application mobile embarquée exploite E4B pour décrire des produits à partir d’images et générer des recommandations locales. Le tout fonctionne hors réseau, même dans un sous-sol sans 4G. Au siège, un service back-office s’appuie sur 26B MoE pour classer les tickets en temps réel, tandis qu’un cluster 31B Dense synthétise des rapports hebdomadaires à partir de milliers de lignes et de PDF techniques. Ce chaînage reflète la complémentarité edge–cloud.

Les agents autonomes gagnent en robustesse grâce aux appels de fonctions et aux sorties JSON. Ainsi, un agent peut consulter un stock via API, proposer un réassort, puis déclencher une commande validée par une règle. Dans la santé, des assistants on-device transcrivent des comptes rendus vocaux et extraient des codes CCAM localement pour améliorer la confidentialité. Ces avancées rejoignent un mouvement plus large d’adoption de l’IA en entreprise, déjà documenté dans cette analyse de l’adoption en 2025, et prolongé par des approches d’innovation frugale.

La vision intégrée change aussi l’échelle. Une chaîne logistique peut lire des codes-barres endommagés, faire de l’OCR massif sur des bons de livraison et égaliser la qualité sur des photos mobiles. Côté code, la génération locale sert à auditer des dépôts sensibles. Un cabinet legaltech peut charger un corpus privé grâce à la fenêtre de contexte étendue et obtenir des analyses multi-documents. La granularité par modèle autorise une allocation fine des budgets GPU.

Ces trajectoires ne s’analysent pas hors marché. Les offres fermées évoluent vite, comme le montrent les itérations récentes des GPT. Cependant, l’ouverture et l’exécution locale constituent un avantage stratégique pour qui vise la maîtrise du coût et de la donnée. En complément, les directions doivent structurer leurs politiques d’explicabilité et de testing par domaine. C’est ici que la combinaison d’un modèle ouvert et d’une gouvernance métier fait la différence.

Au fil des déploiements, une question surgit: quel modèle pour quel niveau d’autonomie de l’agent? La bonne réponse varie selon le risque, le temps de réponse et la criticité. Avec Gemma 4, l’outil s’ajuste au contexte opérationnel.

Performances, coûts, souveraineté: le triptyque qui fait pencher la balance

Évaluer Gemma 4 exige de croiser métriques techniques et bilan financier. Sur le plan des performances, le 31B Dense vise la qualité maximale et un fine-tuning précis. Le 26B MoE optimise la latence et la consommation. Les E2B/E4B garantissent un mode dégradé sans réseau. En regroupant ces caractéristiques, une architecture hybride répond aux variations de charge et aux contraintes de confidentialité. Le résultat? Un TCO mieux maîtrisé que des solutions 100% cloud fermées sur des usages stables.

La souveraineté et la conformité pèsent aussi lourd. Les organisations peuvent conserver l’inférence à la périphérie et limiter les transferts. Cette approche cadre avec des exigences publiques et parapubliques, et rejoint des réflexions détaillées sur la souveraineté numérique. Lorsque des métiers réclament des garanties de non-exfiltration, l’exécution locale tranche le débat. De plus, la licence Apache 2.0 rassure les acheteurs. Elle clarifie l’aval juridique nécessaire aux grands appels d’offres.

Au-delà, l’ouverture favorise l’écosystème. Des intégrateurs régionaux peuvent bâtir des briques modulaires et les maintenir sur la durée. Les communautés améliorent les prompts templates, les recettes de quantization et les jeux évaluatifs. Par ricochet, les retours du terrain irriguent les feuilles de route, ce qui accélère la maturité produit. Face à la vitesse de concurrentes fermées, ce modèle de progression collective se révèle compétitif, comme l’illustrent les comparaisons issues de plusieurs analyses de marché.

Enfin, la dimension multilingue mérite une attention spécifique. Gemma 4 gère plus de 140 langues et opère une vision robuste, ce qui fluidifie les parcours utilisateurs globaux. Dans le tourisme, un assistant peut analyser une photo de menu, traduire et recommander un plat, même sans réseau. Dans l’industrie, la documentation technique multiformat devient requêtable. En somme, l’IA ouverte renforce l’autonomie opérationnelle et la qualité de service, sans surcoût systémique.

La balle est désormais dans le camp des équipes produit. Elles doivent relier objectifs, données et outils, puis tracer une courbe d’apprentissage réaliste. Avec Gemma 4, l’histoire ne se joue pas seulement dans les performances brutes, mais dans la capacité à industrialiser sans friction. Voilà ce qui, souvent, fait basculer une expérimentation en avantage concurrentiel durable.

On en dit Quoi ?

Gemma 4 coche les cases qui comptent en 2026: ouverture réelle sous Apache 2.0, couverture complète du mobile au cloud, et fonctionnalités multimodales solides. Les entreprises obtiennent enfin un levier pragmatique pour marier innovation et mise en production rapide. L’écosystème outillé et la compatibilité large réduisent les frictions, tandis que la souveraineté progresse grâce à l’exécution locale. En bref, Google propose un socle ouvert crédible pour la prochaine vague d’agents et d’applications d’intelligence artificielle, avec un rapport valeur/coût qui incite à passer du test au déploiement.

Spécialiste en technologies et transformation numérique, fort d’une expérience polyvalente dans l’accompagnement d’entreprises vers l’innovation et la dématérialisation. Âgé de 26 ans, passionné par l’optimisation des processus et la gestion du changement.